AI와 전쟁 ② 선이 그어지고, 지워지고, 처벌받기까지

2018년: 선이 그어졌다

2018년 4월, 구글(Google) 직원 3,100명이 CEO 순다르 피차이(Sundar Pichai) 앞으로 서한을 보냈다. 서한은 이렇게 시작한다.

우리는 구글이 전쟁 사업에 관여해서는 안 된다고 믿는다.

서한의 계기는 ‘프로젝트 메이븐(Project Maven)’이었다. 미 국방부가 2017년 시작한 이 프로젝트는 드론 영상을 AI로 분석해 표적을 식별하는 것이 목적이었다. 구글이 자사의 AI 기술 텐서플로우(TensorFlow)를 제공하고 있었다.

직원들은 서한에서 이렇게 경고했다.

직접적인 적용 범위를 좁힌다 해도, 이 기술은 군을 위해 만들어지고 있으며, 납품되면 이런 용도에 쉽게 전용될 수 있다.

우리 기술의 도덕적 책임을 제3자에게 외주할 수 없다.

약 12명의 직원이 항의 사직하며 반대의 목소리를 냈다. 구글은 프로젝트 메이븐 계약을 갱신하지 않았다. 100억 달러 규모의 펜타곤 클라우드 계약(JEDI) 입찰에서도 철수했다. “AI 원칙에 부합하는지 확신할 수 없다”는 이유였다.

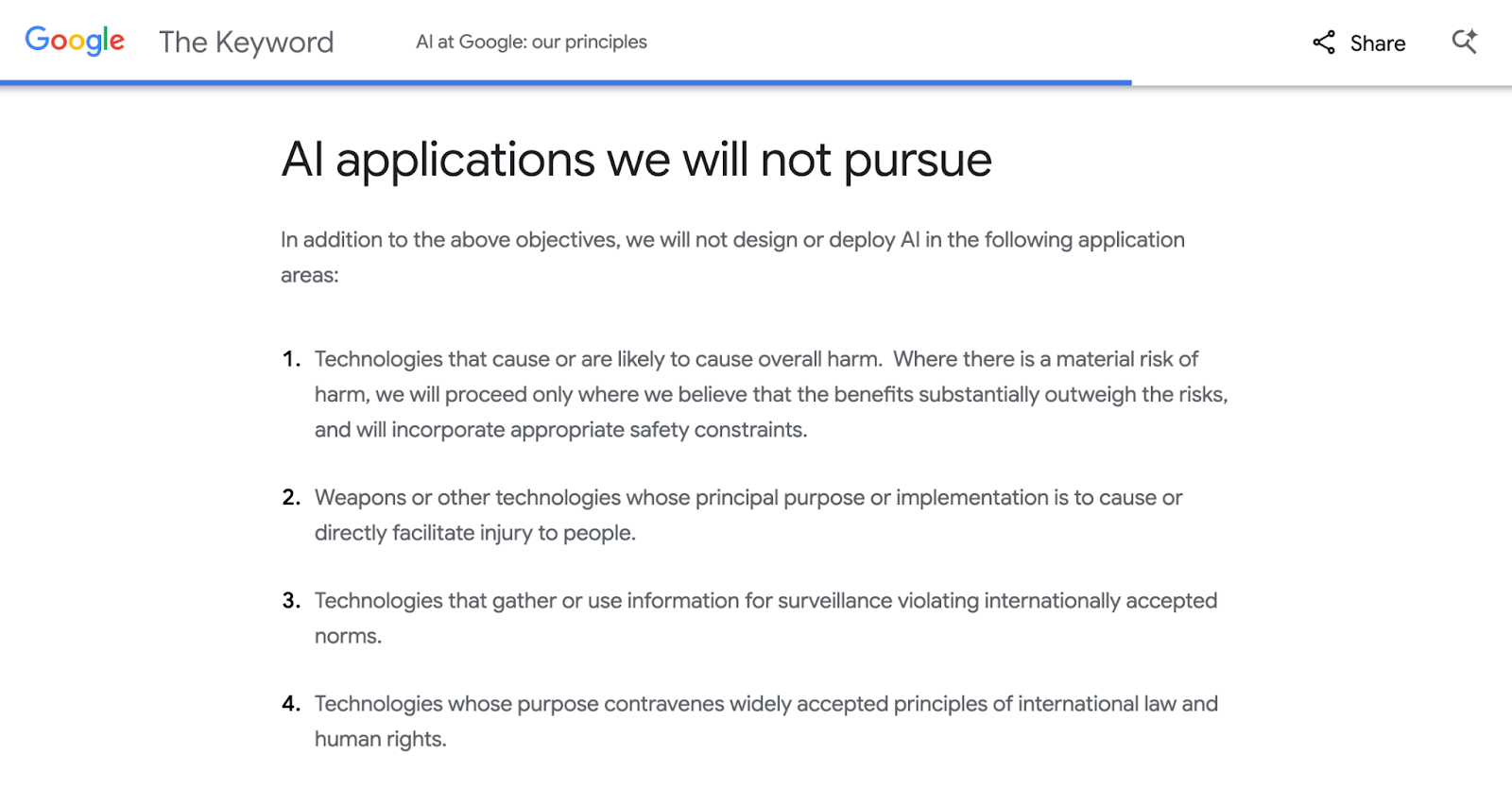

2018년 6월, 구글은 ‘AI 원칙(AI Principles)’을 발표한다. 여기에는 “추구하지 않을 응용 분야(Applications we will not pursue)” 섹션이 포함돼 있었다.

- 사람에게 상해를 입히는 것을 주된 목적으로 하는 무기 또는 기타 기술

- 국제적으로 받아들여진 규범을 위반하는 감시 기술

- 전반적인 해악을 야기하거나 야기할 가능성이 있는 기술

주요 AI 기업이 AI의 군사 사용에 공식적으로 선을 그은 것은 이때가 처음이었다.

2025~2026년: 선이 하나씩 지워졌다

2025년 2월 4일, 트럼프 2기 행정부 출범 15일이 되는 날 구글은 AI 원칙을 업데이트했다. “추구하지 않을 응용 분야” 섹션이 통째로 삭제됐다.

이전 버전과 비교하면, ‘무기(weapons)’도, ‘감시(surveillance)’도, ‘전반적인 해악(overall harm)’도 모두 금지 목록에서 사라졌다. 대신 “핵심 가치인 자유, 평등, 인권 존중에 따라 민주주의 국가들이 AI 개발을 주도해야 한다”는 문장이 들어왔다.

구글의 전 AI 윤리팀(Ethical AI team) 공동 리더 마거릿 미첼(Margaret Mitchell)은 블룸버그 보도에서 이렇게 말했다.

원칙을 제거하는 것은 AI 윤리 분야의 연구자들과 활동가들이 구글에서 이뤄낸 성과를 지우는 것이다. 더 큰 문제는, 구글이 이제 사람을 죽일 수 있는 기술을 직접 개발할 가능성이 높아졌다는 것이다.

선을 지운 것은 구글만이 아니었다.

챗지피티(ChatGPT) 개발사인 OpenAI는 미션 스테이트먼트에서 “안전(safety)”를 핵심 가치에서 제거했다. 2026년 2월 27일, 앤트로픽이 블랙리스트에 오른 바로 그 날, OpenAI는 펜타곤과 계약을 체결했다.

OpenAI는 “이번 협약이 앤트로픽의 협약을 포함한 기존의 어떤 협약보다 더 강력한 안전 장치를 갖추고 있다”고 주장하며 계약 조항을 공개했다. 대규모 국내 감시, 자율무기 지휘, 중대한 의사결정 자동화를 금지한다는 내용이다. 다만 계약 문구에는 “모든 합법적 목적을 위하여 AI 시스템을 사용할 수 있다”는 조항이 포함돼 있다. 앤트로픽이 거부한 바로 그 표현이다.

xAI의 그록(Grok) 모델은 펜타곤이 요구한 “모든 합법적 사용(any lawful use)” 기준을 수용하고, 기밀 시스템 접근 승인을 받았다.

2018년에 그어진 선이, 7년이 지나 하나씩 지워지고 있었다.

한편, 전쟁 현장에서는

AI 기업들이 선을 긋거나 지우는 동안, 실제 전쟁에서 AI는 이미 사람을 죽이는 데 활용되고 있었다.

가자 전쟁: AI가 37,000명의 표적 목록을 만들었다

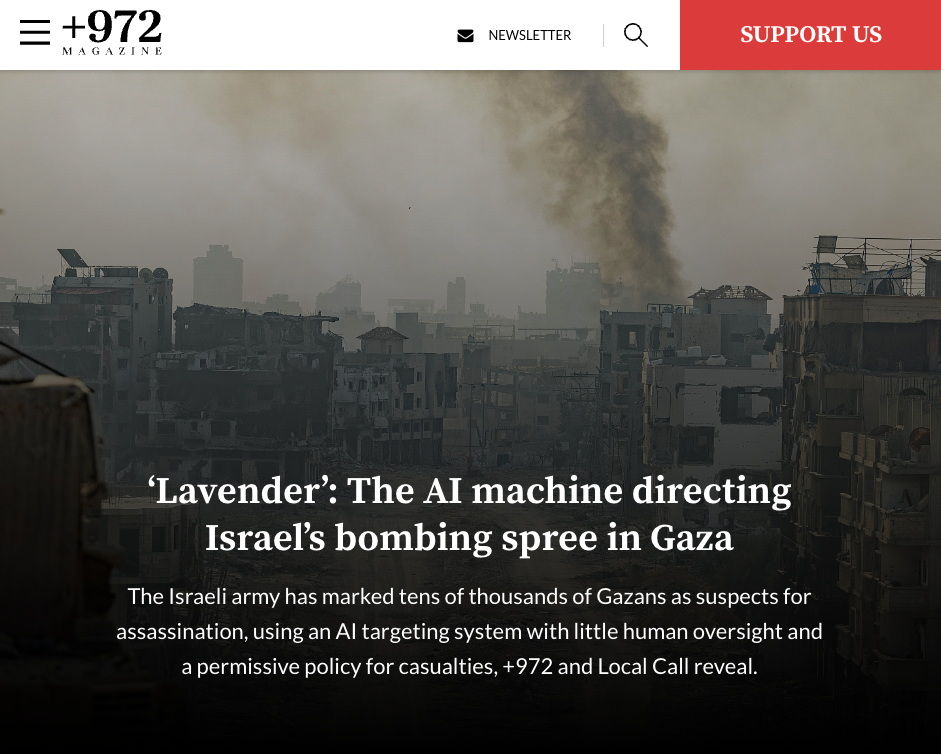

2024년 4월, 이스라엘 매체 +972 매거진(+972 Magazine)과 로컬콜(Local Call)이 이스라엘군 정보장교 6명의 증언을 바탕으로 보도한 내용에 따르면, 이스라엘군은 ‘라벤더(Lavender)’라는 AI 시스템을 사용해 가자 지구 주민들에게 “무장 단체 소속 가능성” 점수를 매기고, 공격 대상을 선정해왔다.

정보장교들의 증언에 따르면, 이 시스템은 37,000명을 잠재적 공격 대상으로 지목했고 분석관이 라벤더가 지목한 표적을 공격하라고 승인하는 데 걸린 시간은 평균 20초였다. 이 외에도 이스라엘군은 ‘웨어즈 대디(Where's Daddy?)’, ‘더 가스펠(The Gospel)’ 라는 이름의 AI 시스템으로 생성된 표적을 바탕으로 공습을 진행했다.

2025년 5월 공개된 이스라엘 군사 데이터베이스 기록에 따르면, 가자 사망자 중 전투원은 17%, 나머지 83%는 민간인이었다.

우크라이나 전쟁: “사람은 항복할 때만 봤다”

우크라이나에서는 AI가 전쟁을 다른 형태로 바꾸고 있다. 한 러시아 포로의 증언이 상황을 요약한다. “사람은 항복할 때만 봤다. 드론뿐이었다. 엄청나게 많았다.”

2022년 전면 침공 초기, 우크라이나군의 드론 작전은 누구나 살 수 있는 민간 촬영용 드론에 예비 배터리 몇 개를 들고 적의 위치를 정찰하고 포병에 좌표를 넘기는 수준이었다. 3년 뒤, 드론은 정찰 도구가 아니라 주력 타격 수단이 됐다. 전선에서 적을 직접 타격하는 공격 중 약 70%가 드론에 의한 것으로 추정되며, 한때 전장의 상당 부분을 차지하던 포병의 비율은 10~15%로 줄었다.

변화의 결정적 요인은 AI의 도입이었다. CSIS(전략국제문제연구소) 보고서에 따르면, AI를 탑재한 드론은 수동 조종 드론보다 표적 명중률이 3~4배 높다. 인간 조종사가 표적을 지정하면, AI가 마지막 수백 미터를 스스로 비행해 접근한다. 러시아의 전자전 장비가 통신을 방해해도, AI 드론은 신호 없이 표적에 도달할 수 있다.

2024년 기준으로 우크라이나군이 운용하는 드론 중 AI를 탑재한 드론은 0.5%에 불과했다. 우크라이나 정부는 이 비율을 50%로 올리려 하고 있다.

AI 드론 여러 대가 하나의 팀처럼 움직이며 스스로 공격 순서를 결정하는 군집(swarm) 기술도 실전에 등장했다. 우크라이나 회사 스워머(Swarmer)가 개발한 이 소프트웨어는 정찰 드론과 공격 드론 여러 대가 한 팀으로 작전을 수행할 때 어느 드론이 언제 어디를 공격할지 AI 기술로 판단한다. 자율 군집 드론을 실전에서 본격적으로 사용한 것은 우크라이나군이 세계 최초다.

이란 전쟁: “첫 24시간에 1,000개 표적”

그리고 지금, 대규모 전쟁에서 AI가 실시간으로 활용되고 있다.

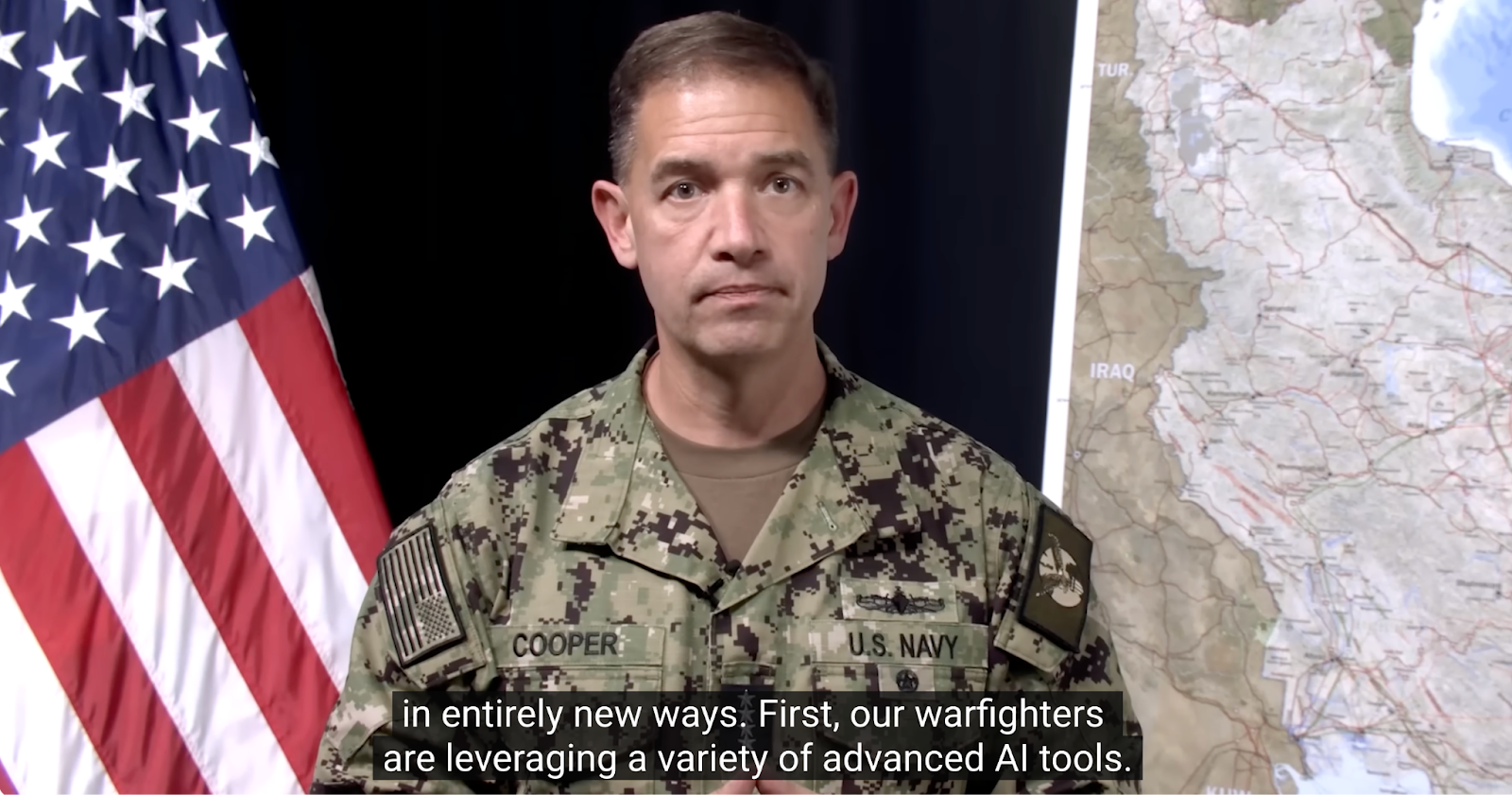

2026년 2월 28일, 미국과 이스라엘이 이란에 공습을 시작했다. 첫 24시간에 약 1,000개 표적이 타격됐다. 11일간 누적 타격 수는 5,500개 이상. 이전의 전쟁에서는 몇 주가 걸렸을 속도다.

미 중부사령부(CENTCOM) 사령관 브래드 쿠퍼(Brad Cooper) 제독은 공식 영상 메시지에서 AI를 전쟁에 사용하고 있다고 밝혔다.

우리 전투원들은 다양한 첨단 AI 도구를 활용하고 있다. 이 시스템들은 몇 초 만에 방대한 데이터를 분석해, 지휘관들이 적보다 빠르게 결정을 내릴 수 있게 한다.

그리고 “무엇을 타격하고, 무엇을 타격하지 않으며, 언제 타격할지 최종 결정은 항상 인간이 한다”고 덧붙였다.

워싱턴포스트에 따르면, 앤트로픽의 클로드(Claude)는 미 트럼프 대통령과 헤그세스 국방장관의 금지 조치 이후에도 팔란티어(Palantir)의 메이븐 시스템을 통해 이란 표적 식별과 우선순위 선정에 계속 사용되고 있다. 앤트로픽을 “공급망 위험”으로 지정하고 “즉시 사용 중단”을 명령한 같은 정부가, 같은 기술을 전쟁에 쓰고 있는 것이다.

기술을 공급하는 기업들

가자의 라벤더, 우크라이나의 AI 드론, 이란의 실시간 표적 선정 등 이 기술들은 하늘에서 뚝 떨어진 것이 아니다. 뒤에는 기술을 만들고 공급하는 기업들이 있다. 그리고 그 사업은 급격히 커지고 있다.

팔란티어: “우리 제품은 사실상 미군 그 자체다”

팔란티어(Palantir)는 미군에 AI 소프트웨어를 공급하는 상장 기업이다.

2025년 8월, 미 육군은 팔란티어와 최대 100억 달러 한도의 포괄 계약을 체결했다. 기존 75개 계약을 하나로 통합한 것으로, 향후 10년간 육군의 소프트웨어와 데이터 인프라를 팔란티어가 담당한다. 같은 해 국방부는 프로젝트 메이븐 계약을 7억 9,500만 달러 증액했다. 2026년 2월 발표된 실적에 따르면 미국 정부 매출은 전년 대비 66% 성장했다.

CEO 알렉스 카프(Alex Karp)는 실적 발표에서 이렇게 말했다.

미국은 더 치명적(lethal)이 됐고, 더 자신감을 갖게 됐으며, 적대국과의 격차를 더 벌렸다.

우리 제품은 가장 진보된 형태에서 사실상 미군 그 자체다. (Our product, actually, in its most advanced form, is the U.S. military.)

프로젝트 메이븐은 사라지지 않았다

한편, 프로젝트 메이븐은 구글이 2018년 이탈한 후에도 조용히 진화했다. 블룸버그(Bloomberg)에 따르면, 메이븐은 드론 영상 분석을 넘어 AI 기반 표적 추천 시스템이 됐다. 운용자는 AI가 제시한 표적을 검토하며 “수락, 수락, 수락”을 반복하는 방식으로 의사결정을 가속할 수 있다. 이 과정에서 표적 처리 속도는 시간당 약 30개에서 최대 80개 수준까지 증가했다.

선을 지키려 한 기업

이 흐름 속에서 앤트로픽은 AI의 군사 사용에 명시적 제한을 유지해 온 주요 AI 기업이지만, “선을 모두 지켰다”고 보기는 어렵다. 앤트로픽 자체도 군사 사용의 범위를 점진적으로 넓혀왔기 때문이다.

앤트로픽은 2024년 11월 팔란티어와 파트너십을 맺고 미 정보기관과 국방부에 클로드를 공급하기 시작했다. 2025년 7월에는 국방부와 2억 달러 규모의 계약을 체결했다. 같은 해 12월에는 미사일 방어와 사이버 방어에 클로드를 사용하는 것도 수용했다. 2026년 1월에는 미군의 베네수엘라 마두로 전 대통령 체포 작전에 클로드가 사용됐다는 보도가 나왔다.

그럼에도 앤트로픽이 끝까지 유지한 것은 두 가지 제한 선이었다. 인간의 감독 없는 자율살상무기, 그리고 미국 시민에 대한 대량 감시. 나머지 군사 사용은 이미 수용한 상태였다. 펜타곤은 그 두 가지마저 용납하지 않았다. 앤트로픽은 소송으로 맞섰고, 그 소장의 구체적인 내용과 법적 쟁점은 ‘“개처럼 쫓아냈다”...트럼프와 앤트로픽의 대결’에서 다뤘다.

2018년, 구글 직원 3,100명이 “전쟁 사업에 관여하지 말라”고 서한을 보냈다. 7년 뒤인 2026년, 그 구글의 직원들이 — 딥마인드 수석 과학자 제프 딘을 포함한 — 앤트로픽을 지지하는 법원 의견서에 서명했다. 자기 회사가 지운 선을 다른 기업이 지키려다 처벌받자, 개인 자격으로 나선 것이다.

법원 의견서와는 별도로, OpenAI 직원 100명 이상과 구글 직원 약 900명이 자사 경영진에게 AI의 무제한 군사 사용을 거부하라는 공개서한에 서명했다. OpenAI의 로보틱스 리더였던 케이틀린 칼리노우스키(Caitlin Kalinowski)는 사임하면서 이렇게 말했다. “사법적 감독 없는 미국인 감시와 인간 승인 없는 치명적 자율성은 충분한 숙의를 거치지 못한 선이었다.”

규칙을 만들자는 목소리, 규칙은 아직 없다

기업과 연구자만이 아니다. UN 사무총장과 국제적십자위원회(ICRC) 총재는 2023년 공동 호소에서 “기계가 인간의 개입 없이 생명을 빼앗을 수 있는 권한과 재량을 갖는 것은 국제법으로 금지돼야 한다”고 촉구하며, 2026년까지 법적 구속력 있는 협약 체결을 요구했다.

그러나 2026년 현재 아직 협약은 없다. UN 총회에서 164개국이 자율무기 관련 결의안을 지지했지만, 미국·중국·이스라엘의 반대로 구속력 있는 합의에는 이르지 못했다. 네이처(Nature)지는 3월 10일 에디토리얼에서 “AI의 전쟁 사용은 그 사용을 규율하는 구체적 규칙이 마련되기 전까지 허용되어서는 안 된다”고 주장했다.

기술은 이미 전쟁에서 사람을 죽이는 데 사용되고 있다. AI가 할 수 있는 일은 빠르게 늘고 있고, 기업들이 그었던 선은 하나씩 지워지거나 옮겨지고 있다. 선을 계속 유지하려 한 기업은 처벌받았다. 규칙을 만들자는 목소리는 커지고 있지만, 규칙은 아직 없다.

앤트로픽 소송의 가처분 심리는 미국 현지 시간 3월 24일이다.